KI generiert Bilder – aber keine Räume: Warum Scene-First der bessere Workflow ist

Das größte Defizit von KI-Videos ist nicht die Bildqualität – es ist der fehlende Raum. Hier zeige ich dir, wie du mit dem Scene-First-Ansatz räumlich konsistente Szenen erstellst.

KI denkt in Bildern, nicht in Welten

Generiere ein Video mit Runway, Kling oder Sora. Schau es dir an. Und dann stell dir eine einfache Frage: Wo bin ich eigentlich?

In den meisten Fällen lautet die Antwort: nirgendwo. Die Kamera bewegt sich durch „etwas“, das aussieht wie ein Raum – aber keiner ist. Es gibt keine konsistente Geometrie, keine stabilen Proportionen, keine räumliche Logik.

KI-Modelle generieren Frames. Nicht Räume.Jeder Frame ist eine neue Vorhersage: „Was könnte hier als nächstes kommen?“ Aber es gibt keine zugrunde liegende 3D-Szene, kein Set, keine Architektur. Der Raum existiert nur in dem Moment, in dem er gerendert wird – und löst sich im nächsten Frame wieder auf.

Warum das ein Problem ist

Im echten Film existiert das Set. Es steht da. Die Kamera kann sich frei darin bewegen – und egal aus welchem Winkel du filmst, die Tür ist immer an der gleichen Stelle. Das Fenster zeigt immer nach Osten. Der Tisch steht immer in der Mitte.

Bei KI-generierten Videos passiert folgendes:

- Geometrie driftet – Wände verschieben sich, Räume werden größer oder kleiner

- Perspektive bricht – Fluchtlinien stimmen nicht überein

- Objekte spawnen und verschwinden – was in Frame 1 da war, ist in Frame 30 weg

- Licht hat keine Quelle – Schatten fallen in verschiedene Richtungen

Das fällt dir vielleicht nicht bewusst auf. Aber dein Gehirn merkt es sofort. Und das Ergebnis: Es fühlt sich „falsch“ an.

Der Paradigmenwechsel: Scene-First

Die Lösung kommt – wenig überraschend – aus dem Film. Denn Film hat dieses Problem nie gehabt. Warum? Weil Film immer scene-first arbeitet:

- Erst das Set bauen

- Dann die Kamera platzieren

- Dann drehen

Der aufkommende Scene-First-Workflow in der KI-Videoproduktion dreht die typische Reihenfolge um. Statt einzelne Clips zu generieren und auf Konsistenz zu hoffen, erstellst du zuerst einen konsistenten Raum – und leitest daraus deine Shots ab.

Methode 1: Das Master-Scene-Image

Die einfachste und heute sofort einsetzbare Methode. Der Workflow:

- Ein detailliertes Establishing Shot generieren – z.B. mit Midjourney, Flux oder DALL-E

- Dieses Bild als Single Source of Truth behandeln – es definiert Raum, Licht, Farbe, Architektur

- Verschiedene Kamera-Perspektiven als Crops extrahieren – Close-ups, Medium Shots, Details

- Diese Crops als Keyframes für Video-Tools nutzen – Runway, Kling, Luma

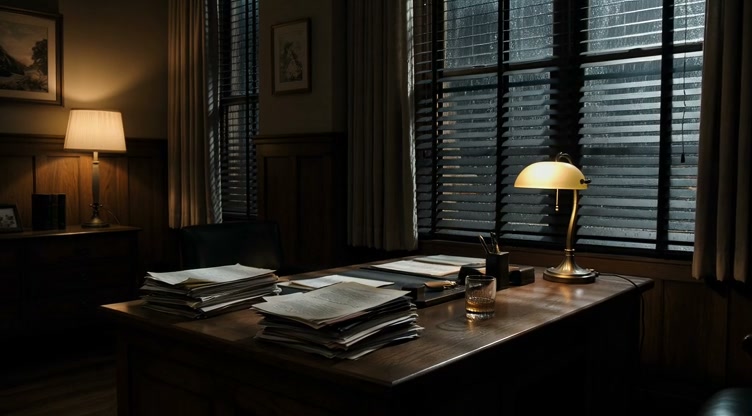

Hier ein Beispiel. Aus diesem Master-Shot eines Film-Noir-Büros:

Haben wir drei verschiedene Kamera-Perspektiven extrahiert – Close-up auf den Schreibtisch, Medium Shot mit Fenster, Detail der Lampe:

Methode 2: 360-Grad-Panorama

Die nächste Stufe: Statt eines flachen Bildes generierst du ein komplettes 360-Grad-Panorama und extrahierst daraus beliebige Kamerawinkel.

Tools:- Blockade Labs Skybox AI – Generiert 360-Grad-Panoramen aus Text in 15 Sekunden, bis 16K Auflösung, HDRI-Export

- ArchiVinci – Bild-zu-360-HDRI mit Lighting Normalization

- 360-Grad-Panorama per Text-Prompt generieren

- HDRI exportieren (für korrekte Beleuchtung)

- In Blender oder Unreal als Environment Map laden

- Virtuelle Kamera platzieren, verschiedene Winkel als Frames rendern

- Diese Frames als Keyframes für Video-Generierung nutzen

Methode 3: 3D-Welt generieren

Die Zukunft – und teilweise schon Gegenwart. Tools, die echte 3D-Welten aus Text oder Bildern erzeugen:

World Labs (Marble)

Gegründet von Fei-Fei Li (Stanford AI-Pionierin). Generiert navigierbare 3D-Welten aus einzelnen Bildern. Keine Zeitlimits, kein Morphing – persistente, explorierbare Räume mit steuerbarer Kamera und Depth of Field. Export als Gaussian Splats.

Higgsfield Cinema Studio 2.5

3D Scene Access: Du kannst ein generiertes Bild als 3D-Szene betreten und räumlich erkunden. 6 virtuelle Kamera-Bodies, 11 optische Linsen, 15+ Regisseur-Bewegungen.

Luma AI Ray3

Erstes Modell mit nativer HDR-Generierung. Simuliert natürliche Beleuchtung und Kamera-Trägheit. Keyframe-Kontrolle für präzise Kamerabewegungen.

Der komplette Scene-First Workflow

Hier mein empfohlener Workflow – heute schon machbar:

- Szene definieren – Ort, Layout, Lichtverhältnisse, Stimmung

- Master-Scene-Image generieren – Ein detailliertes Wide Shot als Anker

- Kamera-Perspektiven definieren – Welche Einstellungsgrößen braucht die Story?

- Shots extrahieren – Crops aus dem Master + Image-to-Image Variationen

- Videos generieren – Keyframes in Runway, Kling oder Luma

Für noch mehr Kontrolle:

- Blockade Labs für 360-Grad-Panorama statt flachem Master-Bild

- World Labs für echte 3D-Navigation

- Charakter-Referenzen (Posing Sheets) mit Scene-Referenzen kombinieren

Praktische Hacks

Reference Images als Anker

Runway Gen-4 erlaubt bis zu 3 Referenz-Inputs pro Generation. Charakter + Umgebung + Stil bleiben dadurch konsistent.

Seed-Kontinuität

Gleicher Seed + gleiche Lighting-Tokens für aufeinanderfolgende Szenen = 99% räumliche Konsistenz.

Keyframe-Qualität entscheidet

Je sauberer der Keyframe, desto weniger muss das Video-Modell „erfinden“ – und desto stabiler bleibt der Raum.

Der eigentliche Insight

Film arbeitet seit 100 Jahren scene-first. Das Set existiert, bevor die Kamera läuft. Die KI-Videoproduktion muss genau das lernen:

Nicht Videos generieren. Sondern Welten bauen.Die Technik ist schon weiter als die meisten denken. World Labs, 360-Grad-Environments, Master-Scene-Workflows – die Werkzeuge für echte räumliche Konsistenz existieren. Man muss sie nur benutzen.

Du willst räumlich konsistente KI-Videos für dein Projekt? Sprich uns an – wir bauen die Welt, bevor wir drehen.

Häufige Fragen

FAQ: KI generiert Bilder – aber keine Räume

Bereit für dein KI-Videoprojekt?

Lass uns darüber sprechen, wie KI-Technologie dein nächstes Videoprojekt besser und günstiger machen kann.

Kostenloses Erstgespräch